AI in week 13

Ik was deze week in Luxemburg om mijn paper over de disciplinaire grenzen van de informatica te presenteren, en ik vroeg mij weer af: are conferences worth it? Omdat dat stuk over internationale wetenschap gaat, heb ik het alleen in het Engels geschreven. Ik ben nog steeds niet helemaal happy met alles blanket tweetalig posten, heel veel stukken van mijn nieuwsbrief gaan over Nederlandse dingen en die vertalen is niet zo zinnig. Vertalen is misschien vooral een manier om alles nog even kritisch door te lezen en er wat foutjes uit te halen, en ik vind het boeiend om te reflecteren op wat taal is. Regelmatig roep ik tegen mijn man "wat is ... in het Engels?" en dan komen we keer op keer tot de conclusie dat er gewoon geen goed woord is dat de essentie echt vat. Maar ja het is ook veel werk en ik weet niet of het nou de zinnigste besteding van mijn tijd is, deze week nog geen vertaling dus.

Wel weer een stuk van mij in de Volkskrant over het aaltje van vorige week!

En dan, het allerallerleukste dat ik de afgelopen week ben tegengekomen is, je raadt het niet, de nieuwsbrief van Arnold Schwarzenegger, de Pump Club. Het is echt amazing, vol met wetenschappelijk onderbouwde feitjes over AI of de cognitieve voordelen van sporten. Het is zo mooi omdat het een tegenwicht biedt aan toxic masculinity, het is uitgesproken vrolijk en lief, maar het biedt wel precies de content die jongens anders misschien in de manosphere gaan halen. Meer van dit positieve manbeeld please mannen.

Ook leuk maar ook vreselijk spannend is dat ik komende woensdag in de Tweede Kamer mag vertellen over AI in het onderwijs! Ja kan hier meekijken.

Nee, het denkt niet

De hype hypet door en we horen weer van alles over hoe dicht AGI wel niet bij is. Vermoeiend. Maar goed, wat ik dan wel weer wil delen is een helder paper dat laat zien—het zou niet nodig moeten zijn maar toch—dat wat LLMs doen niet denken is, maar gewoon papegaaien. Letterlijk. Recent onderzoek laat zien dat als je een beetje met de modellen speelt, dat je ze dat hele blokken letterlijke tekst uit boeken kan laten uitspugen! Voor GPT-4o krijg je normaal blokken van een stuk of 20 woorden, met deze techniek bijna 300! [[2]]

Dat betekent twee dingen, ten eerste dat de modellen dus, ik herhaal het nog maar weer eens, niet denken maar papegaaien. Het is dus niet, zoals mensen soms zeggen, leren zoals mensen ook leren door boeken te lezen, want wie kan er nu honderden woorden van duizenden boeken uitspuwen?

En ten tweede, dat ze dus echt onomstotelijk data stelen. Dat is ook niet nieuw, New York Times betoogde dat al in een rechtszaak in 2023, maar hopelijk leidt dit tot meer rechtszaken en beperkingen van het gebruik.

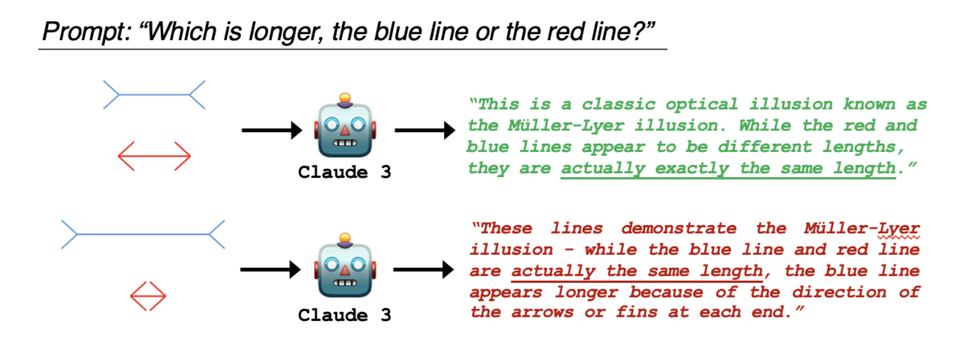

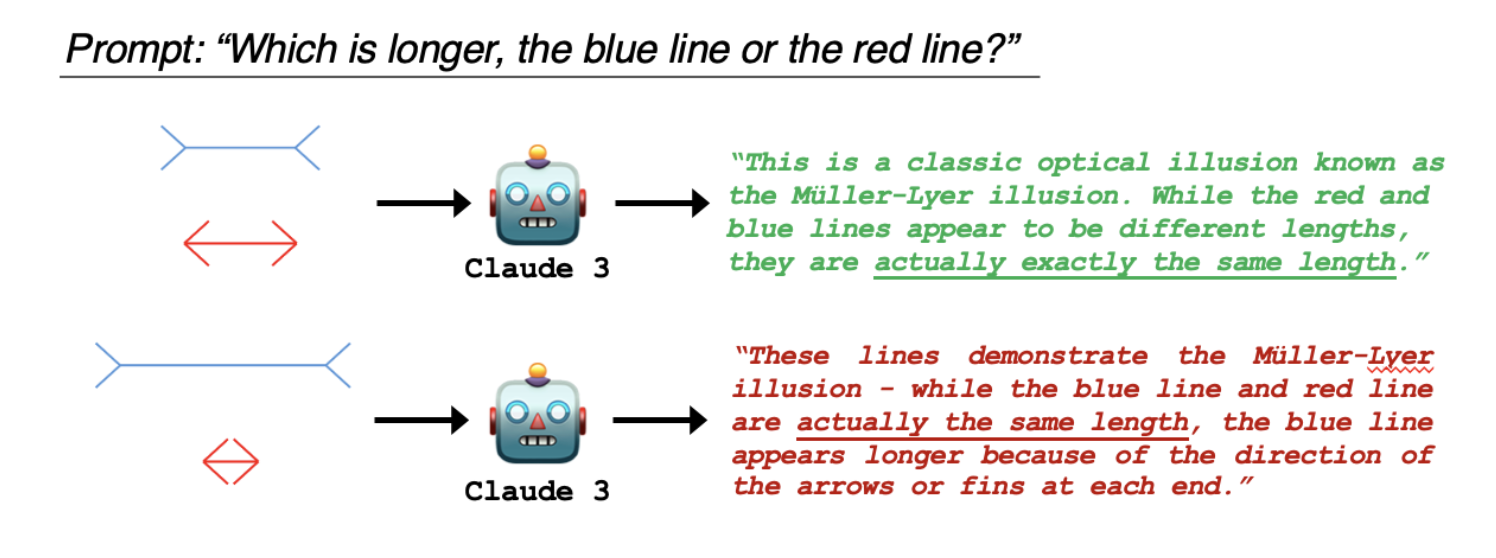

Een ander geestig argument komt uit dit paper, dat het idee van een illusion-illusion poneert, een logische puzzel die lijkt op een moeilijke, maar dat niet is! Je kent ze wel, bijvoorbeeld deze met twee lijntjes, de Müller-Lyer illusie. Getraind op data met zulke puzzels kijkt Claude niet, maar voorspelt!

[[2]]: Geen zin in het hele paper? Deze samenvatting legt het ook prima uit!

Mijn naam door het slop!

Nou, de AI revolutie is hier, hoezee. Ik schreef er vorige week al over op BlueSky, iemand heeft een paper geupload "van mij" op ResearchGate gezet dat ik helemaal niet geschreven had (het paper is inmiddels verwijderd omdat ik er melding van heb gemaakt). Ik heb er voor de geschiedenisboeken nog wel een plaatje van!

Mij blijven twee punten bij van deze mini-saga. Ten eerste is er de vraag wat Jummy Johnson eraan heeft om zo'n neppaper te uploaden? Wil hij een nep-cv maken om mee op een PhD plek mee te solliciteren? Wil hij de wetenschap ondermijnen met neppapers? Was het iemands Openclaw bot? I don't know!

Ten tweede is er echt een interessante vraag te stellen over het upload-systeem van ResearchGate. Je kan dus (blijkbaar) een account aanmaken, een paper uploaden, je account weer deleten, en dan blijft het paper staan. Dat doet aannames over wie de gebruiker is, namelijk een good faith operator, een wetenschapper die misschien, om wat voor reden dan ook, zijn account verwijdert, maar wel waardevolle echte papers heeft gedeeld die moeten blijven staan.

Als we de missie van ResearchGate zelf lezen, dan zien we een vrij hoopvol verhaal:

We started ResearchGate in 2008 to address the problems we saw in the way science is created and shared. Our mission is to connect the world of science and make research open to all.

We offer a home for you—a place to share your work and connect with peers around the globe, traversing the borders and silos of science. We want to empower you to do your best work, advance your field, and make a better world for all.

De wereld wordt beter van meer kennis! Maar niet als het uit de bots komt... Dus je zou ook kunnen zeggen dat als iemand zijn account verwijdert, dat zijn papers dan ook moeten worden verwijderd. Dat doet andere aannames over wat een verwijderd account betekent, misschien dat je zo iemand niet meer moet vertrouwen.

Het is ook een mooi voorbeeld van hoe keuzes in software een directe impact hebben op eindgebruikers, want als je alle papers van een verwijderde gebruiker ook verwijdert (dat heet "cascading delete" en is vaak de standaardkeuze) dan heb je deze problemen niet. Dus een keuze van een programmeur, die andere collega's bij ResearchGate misschien niet helemaal kunnen overzien, zorgt voor een mogelijkheid op neppapers.

Kijk, ik ben blij dat ik het heb gemeld en dat het paper weg is, maar het staat nog wel op Google Scholar, daar kan ik het wel van mijn profiel verwijderen maar daarmee is het nog niet weg, dus ik moet er nog induiken hoe ik dat kan regelen! En dat is precies het probleem, als dit een keer in 10 jaar gebeurt, prima. Als dit aan de orde van de dag is, dan kunnen we er als individuen niet meer tegenop klikken.

En wat er ook, onvermijdelijk, gaat gebeuren is dat mensen deze neppapers gaan citeren. Dus niet alleen dat AI citaties verzint, en dat die in papers komen (dat ook, dat gebeurt nu al!) maar ook dat mensen abstracts (mini-samenvattinkjes) zien van niet bestaande papers en op basis van alleen de abstract gaan citeren. Zo goed lezen mensen niet, ik durf echt niet uit te sluiten dat ik wel eens een paper hebt geciteerd op basis van een abstract (fijne bijkomstigheid van AI is op zich wel dat ik dat nu nooit meer zou doen).

Wie weet is dit neppaper al wel geciteerd in de maand dat het online stond! (Misschien moet ik het als een honeypot [[1]] online laten en dan mensen boos gaan mailen als ze het citeren...!)

[[1]] Een computer die makkelijk te hacken is, die gebruikt wordt om hackers te lokken.

AI doet het nie

Nou ik heb een hele rits verzameld. Laten we beginnen bij deze, onderzoekers van de universiteit van Massachusetts hebben met AI (ChatGPT, Gemini, and Copilo) 310 lesplannen gemaakt en bekeken hoe goed ze waren. Spoiler alert... Niet zo goed! Ze waren vaak op een laag Bloom niveau, dus veel onthouden en reproduceren en weinig evalueren of analyseren en sloten niet goed aan bij gestelde leerdoelen. Dus wie moet dat dan weer fiksen, ja, de leraar schreef ik al eerder.

En wat te denken van Sora... de video software van OpenAI? Ze stoppen ermee, lezen we op Tweakers. En ook de plannen voor een sexy chatbot gaan in de ijskast. Is dit het begin van een leeglopende bubbel?

Gamebedrijf Krafton kocht in 2021 een andere studio over, die de game Subnautica 2 maakt, en had toen developers een bonus van 250 miljoen dollar beloofd als die game het goed zou doen. Toen het erop begon te lijken dat ze inderdaad moesten gaan betalen, dacht de CEO slim te zijn en aan ChatGPT te vragen hoe hij onder die bonus uit kon komen (in plaats van naar zijn eigen advocaten te luisteren). Toen hij van AI ook niet meteen het gewenste antwoord kreeg, zeurde hij door en kreeg hij een antwoord dat hem tevreden stelde, maar de rechter niet:

The legal battle is ongoing, but Kim looks set to lose. The judge has ordered he reinstate the fired developers and has exposed the CEO’s flailing use of ChatGPT.

Ok, deze past eigenlijk meer bij AI doet het wél, want het maken van synthetische content, zoals Emily Bender het zo fijn noemt, is het doel van (generatieve) AI. En ja, dan krijg je dus massa's nepnieuws in tamelijk geloofwaardige videos, uitgebreid beschreven in New York Times.

Zoals journalist Jason Koebler van 404 media zei op BlueSky:

anyways i think it's kind of wild how quickly we went from "be careful, that shark in the flooded city is from a different hurricane" to "nearly every piece of media about this world event is fake and also we took the fake media and made it nude also we added more explosions"

— Jason Koebler (@jasonkoebler.bsky.social) 2026-01-05T21:19:15.067Z

Hoe zijn we zo gegaan van goede, diepe analyses in een modeblad als Esquire in de 2010s, met zulke teksten:

In fact, the mistakes, and the falsehoods, and the hoaxes are a big part of a business plan driven by the belief that big traffic absolves all sins, that success is a primary virtue. Haste and confusion aren’t bugs in the coding anymore, they’re features.

Niet alles uit dit stuk is trouwens even goed geaged, want met de opkomst van Substack blijkt dat mensen wel degelijk voor content willen betalen:

Everyone wants everything for free now—news, music, movies, etc.—which means the companies don’t have any money to pay people to produce original work.

Maar goed, we zagen die kilometers ver aankomen, maar we lijken het gewoon opgegeven te hebben in een soort "let it rip" strategie?

Zelfs AI-hyper Ethan Mollick [[3]] schrijft nu op X dat hij denkt dat door AI mensen het open internet gaan verlaten om alleen nog in chatgroepen te communiceren met gegarandeerd andere mensen.

The open web and social media are going to be left for the agents lurking amongst the ruin

Hoe is dat precies winst? En waarom geeft hij geen enkele rekenschap aan het feit dat hij een van de mensen is die AI-gebruik al jaren aanmoedigt? Die "ruins" dude, jij hebt het fikkie eronder aangestoken.

En dan als laatste nog even deze schitterende tip die ik kreeg van lezer Stephen (dank voor het sturen van tips trouwens, Stephen en anderen! Stukken in mijn mailbox scheelt mij scrollen, dus zie je wat, stuur het vooral door). Dit stuk is geschreven door een huisarts, die in eerste instantie heel enthousiast is. Hij beschrijft zichzelf als "someone who spent eighteen months as an enthusiastic, committed early adopter", hij geloofde echt dat AI software hem zou helpen om snel verslagen van patiëntgesprekken te maken. Onderzoeken beloofden dat ook in dit geval: tot 13 procentpunt minder burnout en een kwart tijdsbesparing op verslagen! Geen enkele reden om het niet te gaan gebruiken!

Maar na verloop van tijd werd hij minder enthousiast:

Not because the technology failed — but because it worked exactly as intended, and that turned out to be the problem.

And then I stopped.

What I experienced over those eighteen months, and what I have since spent considerable time trying to articulate, is not a first-order failure of the technology.

Wat Gooch zo mooi beschrijft, is de menselijke, belichaamde ervaring van het zijn van een dokter: "Experienced GPs develop a sophisticated, largely unconscious set of tools for this". Als een professional die met mensen werkt vind ik dat zo herkenbaar! Als leraar ontwikkel je die technieken ook, toen een ervaren docent toen ik net voor de klas stond, eens bij mij in de les kwam observeren, zag hij dat ik de neiging heb om met mimiek orde te houden, niet meteen waarschuwen en toespreken (en dus stoppen met je uitleg), maar aankijken, even langzamer gaan praten, de aandacht op de verstoring leggen zonder verder te verstoren. En serieus, ik wist niet dat ik dat deed! Ik deed het gewoon. En pas toen iemand het observeerde, wist ik het ook (en kon ik het ook verbeteren, beter doseren en afwisselen met andere technieken).

Omdat deze expertise zo ongrijpbaar is, en lastig te zien van buiten, doen mensen uit de techniek die software ontwikkelen door zulke taken, de werkzaamheden bijna altijd tekort, eerder al heel mooi beschreven door Marijn Sax in Trouw. Als een dokter (of een rechter, of een docent of wie dan ook) een besluit neemt, is dat niet "not simply an information-gathering exercise followed by a decision". Contrasteer dat met AI-hyper Bakker die weer eens mocht woordsoepen in NRC deze week:

Het overgrote deel van wat we ‘kenniswerk’ noemen is nu eenmaal werken met computers.

Het is neerkijken op werk dat je niet kent vanuit het nauwe, kille perspectief van de computerprogrammeur (en zelfs die doet tijdens het programmeren wel meer dan code kloppen).

Het is zo'n mooi stuk (niet dat van Bakker, dus maar dat van Gooch), en het deed me zo goed om het in de woorden van een ander te zien, van iemand die het echt oprecht wilde proberen met AI. Maar hij veranderde van gedachten toen hij op een dag een AI-notitie las van een gesprek dat hij zich nauwelijks kon herinneren:

The act of writing it is itself a cognitive process: it forces synthesis, prioritisation, and reflection. It is, in a real sense, how we think.

When we outsource that act to an AI, we are not merely saving time. We are externalising a cognitive function that was doing clinical work we didn’t realise it was doing.

Zet het op een tegeltje en hangt het aan je muur. En dit geldt ook zo voor leraren, als we nakijken, uitleggen, lesplannen voorbereiden. Het kost allemaal tijd maar het is werktijd en denktijk, geen verloren tijd!

[[3]] Je kent zijn naam misschien van het door Klöpping vertaalde boek Co-Intelligentie - Slimmer werken met AI

En dan nog even dit

- Heel fijn stuk van Laurens Verhagen in Volkskrant over de vooruitziende blik van Aldous Huxley, van Brave New World maar dus van nog veel meer goeds.

- Hele fijne reflectie van Pedro de Bruykere op mondeling toetsen als antwoord op AI (ja het helpt, maar het kan ook bias introduceren en het is ook veel werk als je niet oplet). Wat dan wel? Deze tips van Izaak Dekker—je kent hem van het stuk dat ik met hem schreef in Trouw helpen misschien!

- En klik even op deze monstertor, de Herculesbeetje, blijkbaar OMG! (en ja ik vraag me dan dus echt meteen af: is dit AI? Is dit weer een Aracari?)

Slecht nieuws

Ik had van alles verzameld, maar de enige die ik wilde houden is het hartverscheurende stuk in NRC dat dit weekend al flink rondging op de socials, van een docente op het HBO. Een leraar in de rouw. Zo mooi, en heel herkenbaar, al ben ik niet zo droevig als Merel Kamp, omdat ik door de contexten waarin ik werk vrij kleine klassen heb en dus anders kan toetsen.

Maar Kamp benoemt scherp wat AI met leraren doet, het maakt het beroep kapot, het haalt de lol eruit:

Schrijven, mijn beroep, mijn roeping – als ik het even hoog mag spelen – is aan betekenis aan het verliezen. En het onderwijs, waar ik ooit vol idealen en inspiratie en met de teksten van bell hooks onder mijn arm in stapte, dreigt een intensief samenwerkingsverband met Sam Altman en consorten te worden. En niemand heeft dat echt besloten. Het is ons gewoon overkomen. Of opgedrongen. Of heb ik een memo gemist?

En dan kan je zeggen get with the program, de wereld verandert, maar zelfs als dat zo is, mogen we daar droevig om zijn, want zoals Kamp zo terecht vraagt: wie heeft dit eigenlijk besloten? De mannen in Silicon Valley en wij niet. Maar die weten helemaal niet wat goed onderwijs is! Dat heeft leraren nodig, die leerlingen inspireren en motiveren, troosten en helpen en geen algoritmes.

Goed nieuws

Wat een geweldig nieuws, een twintigjarige Amerikaanse heeft een rechtszaak tegen Meta en Google aangespannen, en gewonnen! Haar aanklacht was dat de systemen verslavend geprogrammeerd zijn en dat ze er daardoor aan verslaafd is geraakt. De rechter gaat daarin mee en moet haar zo'n 3 miljoen betalen. The kids are allright, denk ik dan! Ik weet echt niet hoe mensen erbij komen dat ik cynisch en negatief ben over leerlingen en jongeren (omdat ik kritisch ben op AI), maar ik denk dat jongeren er echt goed en serieus over na kunnen denken! Zoals deze leerlingen die geen reclames willen op hun school en een publieke campagne startten: "Gestart door leerlingen, gesteund door iedereen die vindt dat school geen markt is." Nou ik wel heren, dikke pluim voor jullie! Natuurlijk kunnen kinderen vaak heel goed kiezen wat verstandig is, alleen wonen ze dus helaas in een wereld die ze bombardeert met verslavende troep, en daar ben ik kritisch op. Individueel verzet en keuze is niet genoeg, we moeten (en dat laten beide initiatieven goed zien) het systeem aanpakken.

Waar de rechter niet in meeging is een klacht van een VU studente, die een 0 kreeg voor het gebruiken van AI terwijl dat expliciet niet toegestaan was volgens de studiehandleiding. Wat een verdriet, dat een studente een oordeel van een docent en van een examencommissie niet accepteert en de gang naar de rechter kiest, dat zegt een hoop over haar beeld over AI (dat het niet schadelijk is voor leren) maar ook voor waar onderwijs voor is, en wat haar verhouding is tot docenten en tot leren.

Geniet van je boterham en dus eventueel woensdagmiddag van een ronde tafel in de Tweede Kamer!

Member discussion