Het AI nieuws van week 24

Ik ben op reis naar Duitsland om te spreken op een symposium voor jonge wetenschappers, ik zit nog een beetje te twijfelen wat ik daar ga vertellen. Ik weet soms niet of ik het nu juist veel over AI moet hebben, of over meer fundamentele vragen. Ook Bas Hummel vroeg zich dat deze week mooi af.

AI kan niet denken

Het kan je haast niet ontgaan zijn, maar Apple publiceerde deze week een paper waaruit blijkt dat LLMs niet zo goed presteren op relatief simpele schuifpuzzels zoals de torens van Hanoi. Ook Trouw wijdde er een goed leesbaar stuk aan.

Het is grappig om dit paper zo breed gedeeld te zien worden, want het is natuurlijk niet zo nieuw, dit is precies wat experts al jaren zeggen. Zelfs al voor de boom van chatGPT noemde Emily M. Bender taalmodellen al 'stochastische papegaaien', die niet echt kunnen denken (zie ook dit mooie profiel in NRC). Nu noemt ze ze trouwens vaak text extruding machines: tekstbraakmachines zouden wij misschien zeggen!

Het is interessant om de reacties op het stuk te zien. Grote AI fan Ethan Mollick bijvoorbeeld schrijft meteen op LinkedIn dat mensen geen zin hebben om met AI te werken, en daarom overdreven blij zijn met dit resultaat. En ik ben niet te flauw om toe te geven dat daar wat inzit, ik word inderdaad blij van dat iemand helder aantoont dat taalmodellen een relatief simpele puzzel als de Torens van Hanoi niet op kunnen lossen ja, een probleem dat al in 1957 opgelost werd door een van de grondleggers van AI, Herbert Simon.

Maar het is te kort door de bocht om te zeggen dat ik blij ben met het resultaat omdat ik geen zin heb om AI te gebruiken, want de reden dat ik er niet enthousiast over ben (en heel wat mensen met mij) is juist omdat ze niet echt kunnen denken! Natuurlijk kan GPT dat niet, het is een taalmodel en geen algoritme dat een stappenplan volgt (zoals Ilyaz ook goed uitlegt in bovenstaand stuk uit Trouw). en dan zeggen sommige AI fans: "Ja, Felienne, maar mensen maken ook fouten", en dat is natuurlijk zo.

Maar een ouderwets algoritme niet. Een algoritme van een regel of 20 kan probleemloos het probleem van de torens oplossen. En van zo'n programma kan je meteen zeggen: dat is (in een bepaald opzicht) slimmer dan een mens, en beter, en als je het probleem opgelost wilt zien, gebruik je dat. Soms verwijten mensen mij dat ik tegen techniek ben of tegen software of AI, maar dat is echt niet zo (duh, ik heb een programmeertaal gemaakt!).

Waar ik tegen ben is doen alsof taalmodellen echt denken, en alle implicaties die dat heeft. En het verschil tussen algoritme in de betekenis van LLM en algortitme in de betekenis van een stappenplan dat altijd dezelfde uitkomst geeft, en de juiste als het algoritme klopt, dat is nu juist het probleem!

Op Linkedin zag ik dit stuk van informaticus Terry Bollinger, over de worsteling van wiskundigen om om te gaan met AI.

"The difficulty is that the formal and physical worlds of mathematicians and physicists do not generally actively attempt to fool mathematicians and scientists as they do their jobs.

Pattern-seeking mimicry engines, in contrast, do nothing but actively and aggressively seek to fool their testers and designers."

Ja! Ondanks de Turing Test, al 75 jaar oud, zijn we niet voorbereid op machines die ons proberen te foppen. We denken nog heel erg over computers als dingen die, als je tenminste de goede vraag stelt, altijd hetzelfde en het juiste antwoord geven. Ik noem dat soms het "rekenmachine-model": we denken, bewust of onbewust, dat machines het altijd goed doen.

Zeker omdat de LLMs van nu zich, bijvoorbeeld door het gebruik van de ik-vorm, en door het tonen van 'aan het typen' spikkeltjes, voordoen als een mens. Geen worden dat we daar dan een mens in zien, dat doen we al met dingen er een beetje uit zien als een mens!

Of bekijk eens dit filmpje:

Je hebt meteen een narratief in beeld, toch? De driehoekjes zijn een echtpaar, en de één is boos, de andere bang. Het bolletje, het kind, wordt ook bang.

Meer weten over dit effect, dat we de Heider-Simmel illusie noemen, lees je in deze reflectie. Daarin kan je bijvoorbeeld ook lezen dat zelfs als mensen de video achterstevoren bekijken, ze nog een verhaal zien!

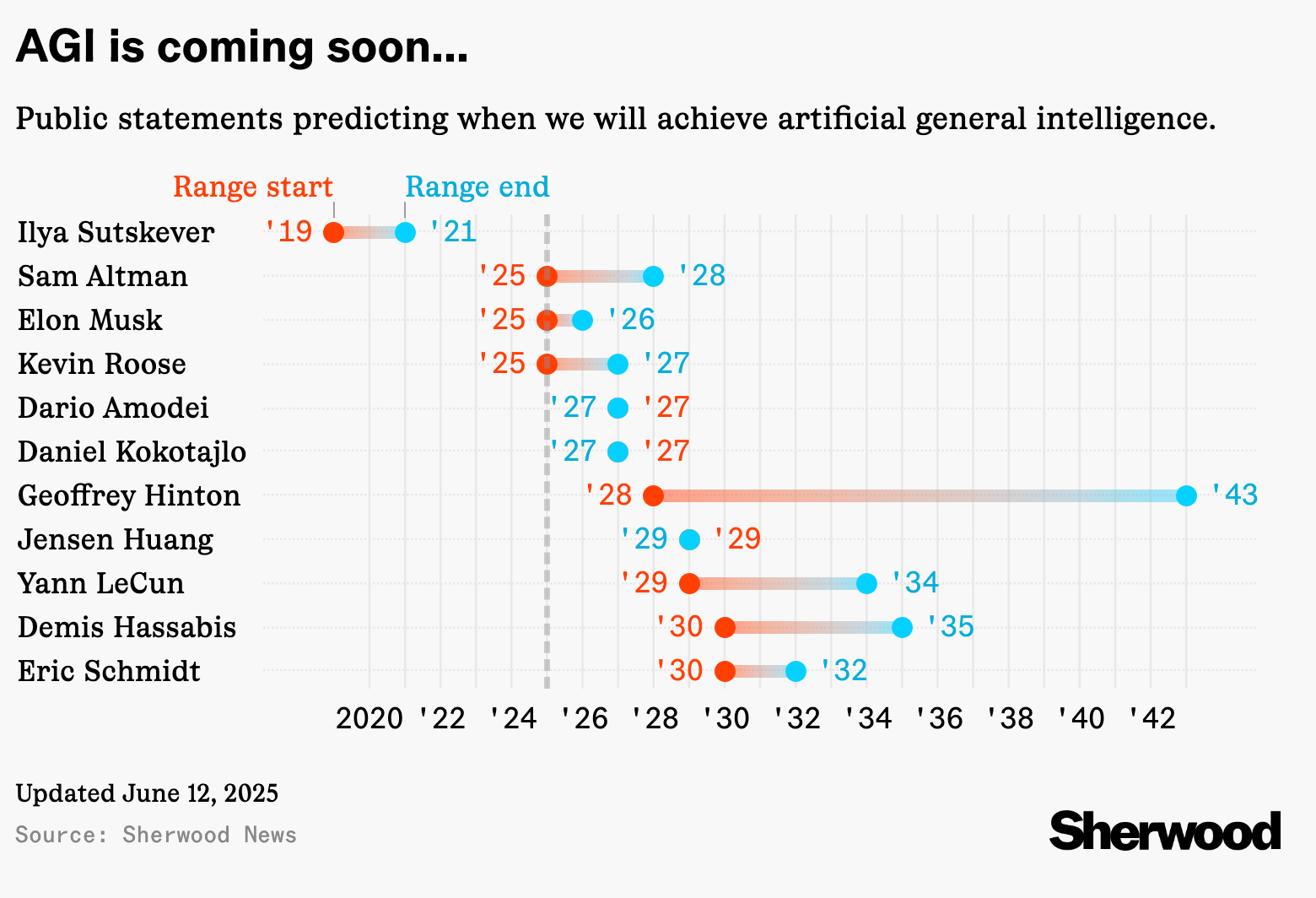

En wie dat natuurlijk heel anders ziet zijn... de heren uit Silicon Valley! Ja, AGI komt er al bijna aan. Op deze geestige website kan je bekijken wie wat allemaal voorspeld heeft.

Het is een beetje onduidelijk waarom juist deze mensen op de lijst staan, want goede voorspellers zijn het bepaald niet! Zo zei George Hinton in 2016 dat we beter kunnen stoppen met het opleiden van radiologen omdat ze binnen 5 jaar niet meer nodig zijn. En Elon Musk heeft al zoveel ongerealiseerde voorspellingen gedaan dat zijn voorspellingen een eigen Wikipedia-pagina hebben! De eerste uit 2013 voorspelde dat 90% van alle trips met een zelfrijdende auto zou gaan kunnen in... 2016! Sherwood belooft het lijstje up-to-date te houden dus dat is er eentje om in de gaten te houden!

Schaken, het fruitvliegje van AI

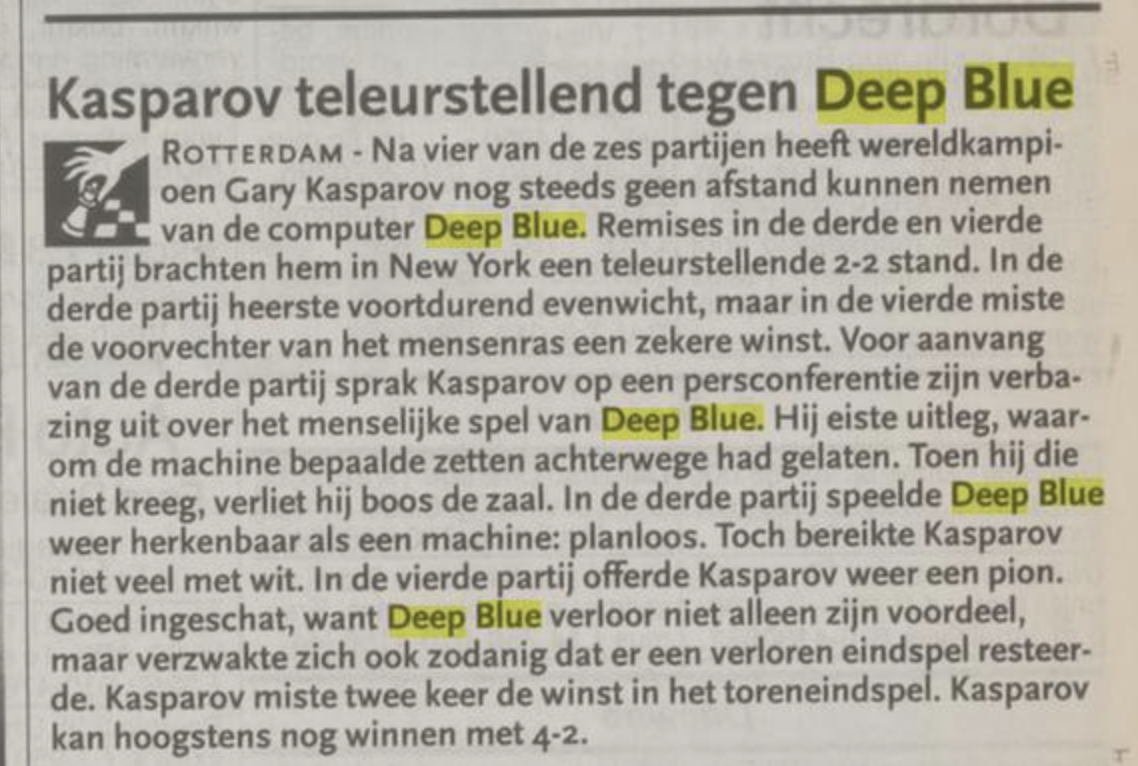

Schaken, heel lang was het de toets voor intelligentie, voor mensen natuurlijk, maar ook voor machines! Tot de jaren 90 werd gedacht dat als we schaken opgelost hadden, dat we er dan wel een beetje waren met AI. Het is leuk om in oude kranten te zoeken naar krantenartikelen uit die tijd op mijn favoriete website van het Nederlandse internet natuurlijk; Delpher! Dit stuk bijvoorbeeld uit het Algemeen Dagblad van 9 mei 1997, ten tijden van de partijen die Kasparov tegen Deep Blue speelde (die Kasparov uiteindelijk verloor met 3½–2½).

Mooi om te zien hoe Kaparov hier uitleg eist, omdat hij ook een mens ziet in de random zetten van de computer. Hoe kan het dat de computer zo menselijk aanvoelt? Ja, dat komt dus door het Heider-Simmel effect, dat Kasparov hier ook toont. Iets dat zich gedraagt als een mens, is dat soms niet stiekem een mens die daar tegen mij zit te schaken?

Eigelijk vraagt hij om wat we nu 'explainable AI' zouden noemen, een uitleg van waarom. Misschien heb je wel het recht (Het tweede Turingrecht?) om te weten hoe de machine tot besluiten komt.

Maar de boeiendere vraag is waarom we schaken zijn gaan zien als een waardig doel voor AI. Een van mijn favoriete wetenschappers op het gebied van de geschiedenis van de informatica (ik noem hem in het Engels mijn scientific crush). Hij heeft een geweldig paper geschreven, wel echt alleen een aanrader als je de geschiedenis van AI net als ik minstens net zo boeiend vindt als het heden of de toekomst. Zijn paper heet Is chess the drosophila of artificial intelligence?, oftewel, is schaken het fruitvliegje van AI? In de biologie is het fruitvliegje, om verschillende redenen, het dier geworden om te bestuderen.

Maar het feit dat onderzoekers voor het fruitvliegje kozen was niet zozeer omdat het beste dier was; het was een handig dier, dat zich goed aanpaste aan leven in het lab, in tegenstelling bijvoorbeeld tot schimmels of platwormen. En de keuze was ook niet zonder effect, zo schrijft Ensmenger, door het fruitvliegje werd veel aandacht besteed aan relatief simpele overerving, en veel minder aan het complexe proces dat een embryo doormaakt.

Ook schaken was niet per se de beste keus, maar een handige keus. Schaken heeft namelijk een heel duidelijke goed of fout toestand: je wint of je verliest (ok of je hebt remise natuurlijk). Voor andere opties die ook in die tijd werden overwogen, zoals machinevertaling, was de succesconditie veel moeilijker te beoordelen, want wanneer is een vertaling goed? Schaken was ook iets dat in de tijd van de opkomst van (oude stijl) AI in de belangstelling stond, en een strijd tussen Oost en West vertegenwoordigde, bijvoorbeeld in tussen Fischer en Spassky. En net als het effect van het fruitvliegje op de onderzoeksagenda, heeft ook de keuze van schaken veel effect gehad. Zo is er heel weinig nagedacht over hoe mensen zich tot AI moeten verhouden, want alleen de aller-allerbeste schakers hoefde met de schaakcomputers te werken. En mensen vroegen ze maar zelden hoe ze zich daarbij voelden trouwens.

Nadat AI eind jaren '90 schaken 'opgelost' had, werd snel het doel verschoven naar een ander bordspel, Go, dat inmiddels ook al opgelost is, in de betekenis dat een AI van de beste mens kan winnen.

Maar nu gaan mensen, net als met de Torens van Hanoi, ook proberen schaken met een LLM te kraken, het fruitvliegje is terug van weggeweest! En net als met de Torens van Hanoi lukt dat, natuurlijk, voor geen meter. Een Atari met 128 bytes aan geheugen [[1]] kan het beter. Nog een keer for the people in the back, een LLM is geen rekenmachine.

Als laatste vind ik het heel boeiend om te kijken naar de impact van Deep Blue. Schaken er minder mensen nu dan in de 90s omdat computers het nu kunnen? Zijn schaakleraren werkeloos? Nee, schaken is juist populairder dan ooit, zo schreef de Ingenieur in 2024. Dat zie ik ook onder jongeren, voordat telefoons niet meer mochten op scholen, zaten heel wat leerlingen op chess.com!

De non-impact van DeepBlue op het plezier in schaken stemt me zo hoopvol. Als een activiteit leuk is om te doen, als je het idee hebt dat je er slimmer van wordt, dan maakt het totaal niet uit of een computer het beter kan dan een mens, dan doen miljoenen mensen het dagelijks met veel plezier!

De onzin van Hassabis

Je zit in een lastig parket als je wilt argumenteren tegen een Nobelprijswinnaar, maar ik ga het toch doen, want het interview dat Wired met Hassabis (CEO van Google Deepmind) publiceerde, zit vol met onzin die ik echt wil aanpakken. Dat was trouwens ook het onderwerp van mijn Ongevraagde Advies van de afgelopen week.

Ook hier zien we weer de vage beloftes van AGI komt eraan, maar daar wil ik het niet eens over hebben, die kennen we nu wel. Irritanter is wat Hassabis denkt dat er gebeurt als wel AGI dan hebben. Drinkwaterproblemen bijvoorbeeld, die kunnen we oplossen door ontzouting. Dat kost wel heel veel energie, maar omdat AGI weet hoe we eindeloos veel groene energie kunnen maken, kan het gewoon. QED. Met welke (en wiens!) grondstoffen we deze technologie moeten bouwen...? Kijk zelf ff joh.

Ernstige ziektes oplossen? AI kan het! Dat mensen nu al geen vaccins meer nemen, en dat de mazelen en polio aan een lekkere comeback bezig zijn...? De journalist zit erbij, en schrijft het op, dat is het erge, het totale gebrek aan doorvragen en kritiek op deze visie op de toekomst.

"We travel to the stars and colonize the galaxy. I think that will begin to happen in 2030."

Ja joh, over 5 jaar gaan we naar de sterren? Wat bedoelt hij dan, naar Proxima Centauri? Iets meer dan 4 lichtjaar is dat reizen, dus dan vertrekken we over een maand of 5 al? Onzin natuurlijk.

Maar in dit wereldbeeld schuilt nog ook iets waar we het over moeten hebben, het idee van abundance, overvloed. Silicon Valley kan zich geen 'eerlijk zullen we alles delen' voorstellen als dat betekent zelf minder hebben, dus om een goed mens te zijn, die doet alsof hij werkt aan de wereld beter maken, moet je je overvloed voorstellen.

Wat is programmeren?

Binnenkort hoeft er niemand meer te programmeren want AI maakt ons zoveel productiever! Of het nu gaan over vibe coding: programmeren in natuurlijk taal zonder veel kennis van systemen zelf, of over het productiever maken van programmeurs die al wel veel van programmeren weten. Leren programmeren heeft geen zin meer, AI neemt je baan over, dat horen we overal (ok vooral van mensen die zelf niet programmeren, denk ik dan).

Je zou wel gek zijn als je het niet gebruikt, schrijft programmeur Thomas Ptacek op de website van zijn werkgever fly.io. Ik wilde eerst van alles gaan aanmerken op Ptacek's zijn stuk, omdat er zoveel instaat waar ik het niet mee eens ben. Dit klopt niet en dat is ook nog eens mis, ik had al een heel stuk staan.

Maar de losse argumenten unpicken is eigenlijk zinloos, want hoe meer ik nadenk over het stuk, hoe meer ik erachter kom dat AI liefhebbers en ik het niet oneens zijn over AI, we zijn het oneens over programmeren. En dan is het logisch dat we het ook niet eens zijn over hoe AI kan helpen bij programmeertaken.

Programmeren is voor mij, zo beschreef ik afgelopen week in een lezing die ik gaf, een manier van maken. Ik hou van tekenen, van kleding maken, van schrijven, en van programmeren en het is voor mij echt allemaal dezelfde activiteit. Het gaat om een onderwerp intens liefhebben en er dan iets van/voor/over/mee/door maken.

Code, zei ik, is "just another fabric", een materiaal om mee te maken.

Ik vind het soms heel raar om een maker te zijn, in een wereld van consumenten. Mensen scrollen en ik zit de hele week te typen, breien en tekenen.

En ik merk dat ik me ook me ook in het woord maker niet thuisvoel. Bij makers denk ik aan maker spaces, aan plekken waar moedwillig iets gemaakt moet worden, aan mensen die van het maken en knutselen houden, maar niet van het ding zelf. Dat maker is ook een vibe die voor mij bij de wereld van programmeren hoort, het programmeren zelf is de lol, niet het ding dat je maakt, dat is maar bijzaak.

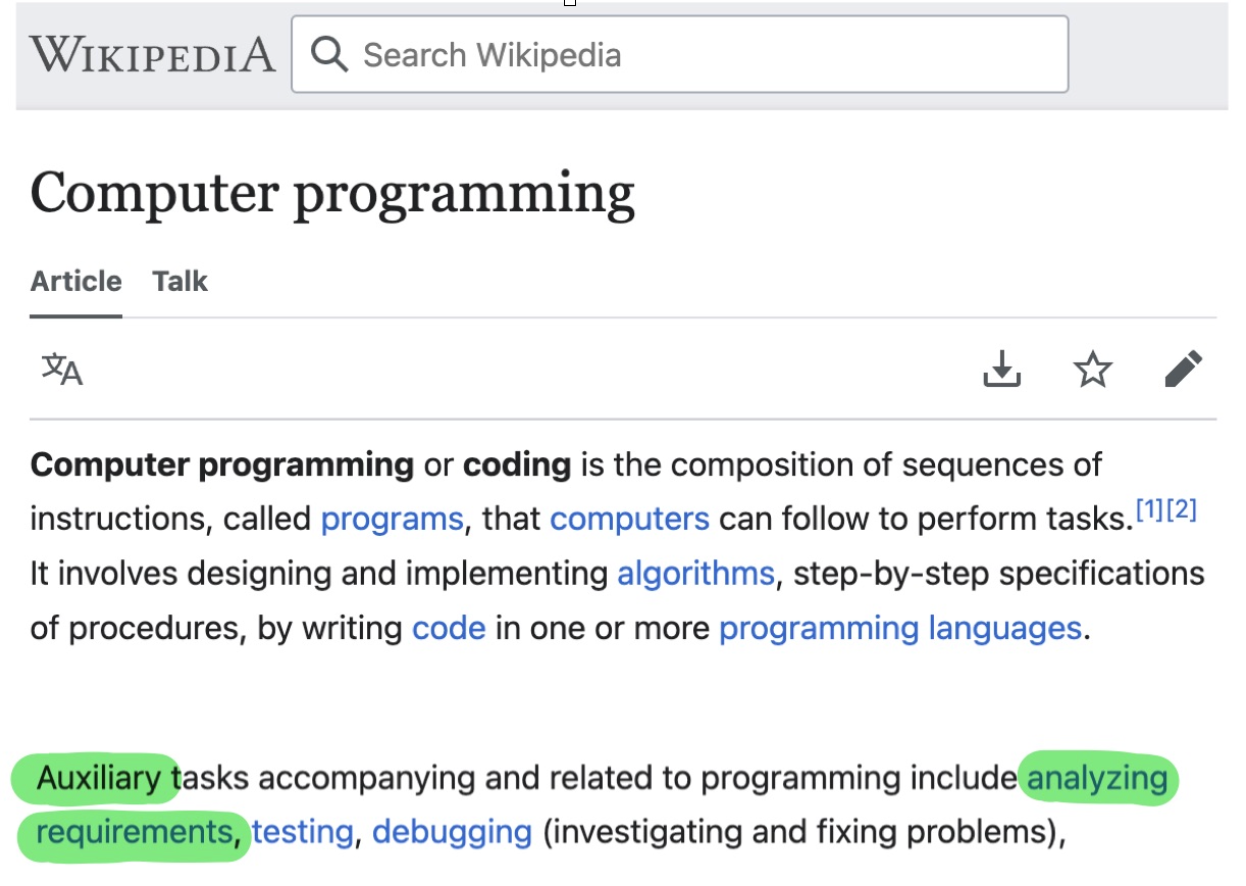

Je ziet het goed als je naar de Wikipedia-pagina van programmeren kijkt. De concepten over programmeren vliegen je om de oren, en wat we gaan maken? Ja, dat is auxiliary.

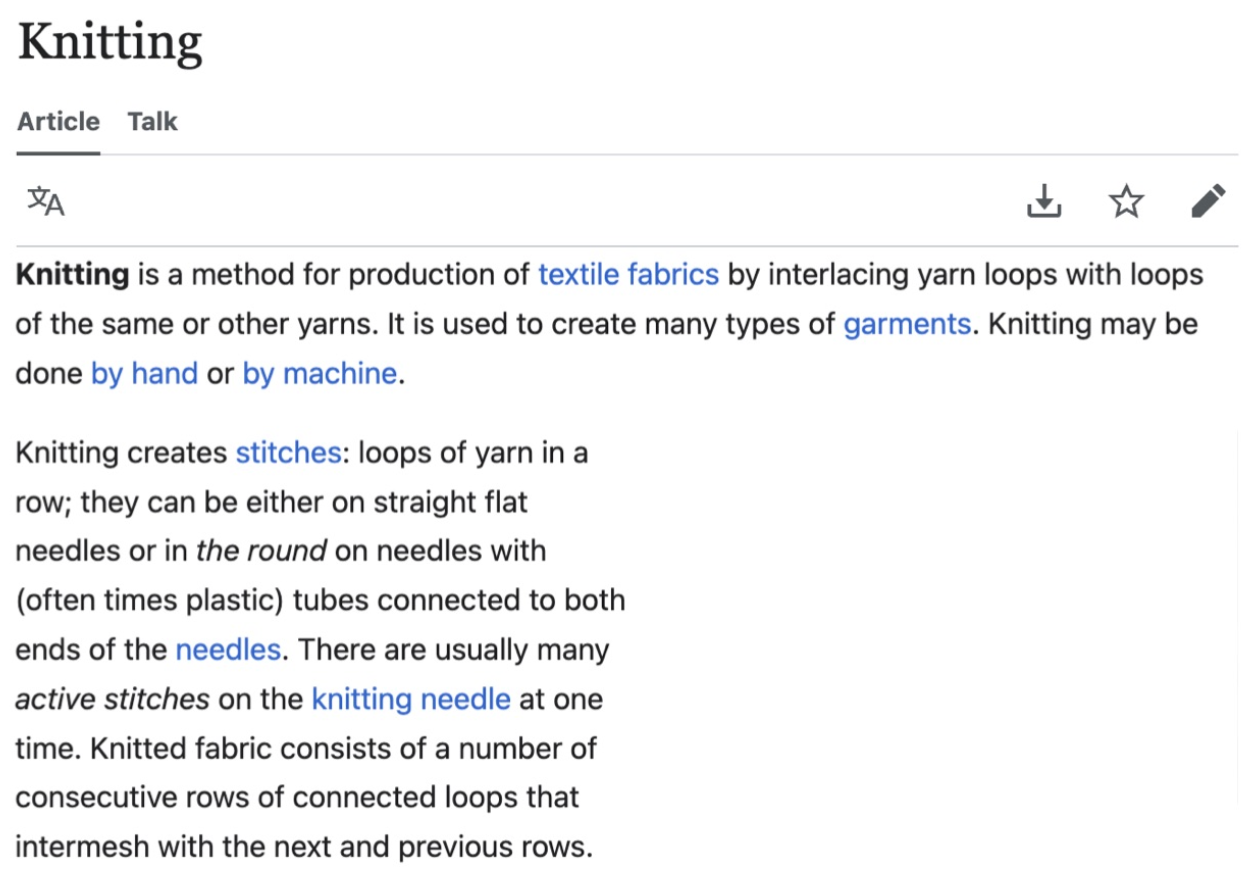

Vergelijk het eens met de Wikipedia-pagina van breien. Regel 1 gaat over wat we aan het maken zijn. Dat is het ding. En natuurlijk komen daar concepten bij kijken die heel complex zijn, algoritmes zou je ze ook prima kunnen noemen, maar die staan niet centraal.

Dus ik hoef eigenlijk helemaal niet over AI te praten als ik het wil hebben over waarom ik niet in AI voor programmeren geloof.

Omdat AI nooit iets kan voelen, en dus, in mijn wereldbeeld—dat natuurlijk het jouwe helemaal niet hoeft te zijn, het is niet eens dat van mijn eigen echtgenoot—nooit iets kan programmeren. Want voor mij kan programmeren[[2]] alleen maar uit liefde voor iets komen, uit een verlangen om iets te gaan maken, of iets gemaakt te hebben.

Die saaie taken waar Ptacek het over heeft ("And most code on most projects is tedious", zegt hij), dat zie ik gewoon niet zo. Ja, het is soms saai om code te schrijven, net als het soms saai is om honderd keer dezelfde steek te breien, maar het wordt een mooie trui, dus het is niet saai, het is gewoon een stop op weg naar een doel dat je wilt.

Net als het soms beresaai is om je kind voor de 10e keer hetzelfde boekje voor te lezen, maar dat doe je uit liefde. En ik wil liefde niet automatiseren. Dus programmeren ook niet.

Vroeg je je trouwens af wat er in dat witte gat linksonder zit van de Wikipedia-pagina van breien? Dit!!

Superbelangrijk natuurlijk om bij deze foto van alleen handen echt even te vermelden dat dit een vrouw is! We zouden nog eens gaan denken dat mensen van alle genders kunnen breien.

Lezen is je morele plicht

Ik hou van lezen, dus als iemand me vertelt dat lezen moet, dan word ik daar blij van! Wil jij ook meer permissie om te lezen, dan moet je dit stuk van Carl Hendriks absoluut niet overslaan. Lezen brengt je in contact met andere mensen, en andere manieren van denken:

"To inhabit unfamiliar minds, to wrestle with conflicting ideas, to sit with discomfort rather than resolve it prematurely got me out of myself and fostered a kind of humility, a recognition that my instincts were not final."

Als kind was ik gek op lezen, ik herinner me van lange kampeervakanties vuurtjes stoken op de camping, maar ook dat ik voordat we gingen naar de bieb mocht en dan wel 6 boeken mee mocht nemen! Wat een feest! En ook als tiener vond ik het nog heerlijk om te lezen. Maar ook bij mij voltrok zich later in mijn leven het proces dat Hendriks beschrijft, dat ik steeds minder en minder ging lezen.

"We are being trained, not explicitly, but implicitly, to treat words as units of utility."

Zelfs een tool als Goodreads, die ik best leuk vind om bij te houden wat ik gelezen heb, veranderen boeken in doelen, en krijg je nudges als je achter ligt op je schema. Je bent dan toch weer met jezelf bezig en niet met een ander(s verhaal). En dat is natuurlijk wat het moderne internet 'wil'.

"Much of the internet wants us to dwell in shallow, curated versions of our own minds. By encouraging us to constantly turn inward through personalised algorithms, we are no longer invited to encounter authentic otherness."

Dus zet je computer eens uit en lees een boek! Hendriks citeert Foster Wallace:

"The really important kind of freedom involves attention, and awareness, and discipline... and the ability to truly care about other people."

Ben je net als ik leraar? Dan ook nog deze bonustip hoe je 'deep thinking' in de klas krijgt: doorvragen en vaker en langer je mond houden!

Lezersvraag

Leuk om te zien dat er echt lezersvragen binnenkwamen deze week. Deze heb ik iets ingekort en de nadruk is ook van mij:

"Ik werk bij een bedrijf waar het AI-beleid momenteel bestaat uit 'experimenteer erop los en we delen elke maand de best practices'.

Ik vermoed dat de directie (net als zo veel organisaties wereldwijd) als de dood is om irrelevant te worden doordat de medewerkers te weinig doen met AI, maar ik vind het ook nogal deprimerend dat dit de insteek is.

Ik wil mijn collega's aansporen om selectief AI in te zetten, dus alleen op die momenten dat er echt mogelijke meerwaarde te behalen valt. Alleen, hoe doe je dat op het moment dat je nog niet zoveel met AI hebt gedaan? Moet ik een paar maanden wachten tot ze er inderdaad op los hebben geëxperimenteerd voordat ik een vingertje ga opheffen? Of juist zo vroeg mogelijk ingrijpen? Of schat ik mijn eigen invloed op de gang van zaken nu sowieso veel te hoog in?"

Ik begin even met de laatste vraag, het doet er voor mij niet zoveel toe of je echt invloed hebt, het gaat er ook om of je je best doet op een betere wereld. We kennen allemaal het verhaal wel van die pacifist die jarenlang iedere dag alleen tegen Vietnam protesteerde [[3]]. "Denk je nou echt dat jij iets verandert aan de oorlog?", vroeg een reporter hem ooit. "Natuurlijk niet, was het antwoord, maar ik wil niet dat de oorlog mij verandert".

Als jij je wilt verzetten tegen AI omdat dat voor jou het beste voelt, moet je dat vooral doen! En, hoopvol trouwens, onderzoek laat zien dat als er maar een persoon is die zich verzet, de kans dan groot is dat anderen dat ook gaan doen! (Dit onderzoek is een replicatie van die bekende Asch-studie over de lengtes van streepjes). Dus het heeft wel zin, zin voor je ziel en zin voor je effect op anderen.

Maar ik wil het ook hebben over het woord experimenteren.

Er bestaat een strategie tegen flauwe seksistische of racistische grapjes, en dat is doorvragen aan de grappenmaker alsof je het echt niet snapt. Reductio ad absurdem, maar dan dat iemand het zichzelf aandoet.

A: "Let maar op, de schoonmaker is hier een Marokkaan."

B: "Waarom moet ik daarvoor opletten?"

A: "Nou ja, je weet wel..."

B: "Nee, sorry, ik weet het echt niet."

A: "Ja, ehm, ja..."

B: "Ja...?"

etc. etc.

Als je dit durft en geloofwaardig kan, werkt het echt heel goed, omdat je de common ground, waarvan de grappenmaker aanneemt dat die er is, weghaalt.

Ik denk dat je dit ook kan doen bij gesprekken over experimenteren met AI (maar daarvoor geldt ook, als je het durft en geloofwaardig kan uitvoeren). Zoiets zie ik dan voor me:

A: "We gaan vanaf nu experimenteren met AI."

B: "Ok, tof, ik heb er zin in! Wat is onze hypothese?"

A: "Dat we AI tijd kunnen besparen op [taak] "

B: "Hebben we historische data over [taak] waartegen we gaan vergelijken?"

A: "Ehhmmm"

B: "Welke methode gaan we inzetten om tijdswinst te meten? Zelf-rapportage is vaak erg onbetrouwbaar [[4]]"

A: "Ehhmmm"

Probeer dit eens uit, schakel je sarcasme even uit, en doe alsof je echt mee wilt doen en probeer te ontdekken wat nu eigenlijk het doel is, terwijl je duidelijk maakt dat de aangenomen common ground er niet is bij jou.

Dan moeten mensen wel toegeven dat ze niet echt experimenteren bedoelen in de betekenis die een wetenschapper eraan zou geven. Zelfs groot voorstander van AI Ernst-Jan Pfauth vroeg zich in een stuk dat betoogde dat experimenteren noodzakelijk is om te weten wat er op het spel staat, af of hij niet gewoon zijn eigen gebruik aan het goedpraten was:

"Praat ik mijn eigen AI-gebruik niet gewoon goed?" - Ernst-Jan Pfauth

Dat is natuurlijk een heel waarschijnlijke hypothese van hemzelf. Je hebt geen zin in die tedious tasks, dus je automatiseert ze en wat blijkt, je voelt je blij! Of je over een jaar breinrot hebt, ach dat zien we dan wel weer, en hoe zou je er ook ooit achter komen trouwens, als je je brein niet meer gebruikt?

Je ziet ook aan dat stuk dat Pfauth niet echt experimenteert in de betekenis dat hij systematisch meet. En allerhande dingen zoals hallucinaties, onvolledigheden, of het vormen van je gedachten voor dat je begint kan je helemaal niet door gebruik vaststellen. Dan zou je, maar dat doet natuurlijk niemand, de hele taak moeten uitvoeren zonder AI, en dan wat je hebt geschreven met een AI antwoord vergelijken.

Tenslotte kan je nog je nog de tip van Ionica Smeets gebruiken (ook nog in heel veel andere gevallen, trouwens), vraag: "Wat zou je van gedachten doen veranderen?".

B: "Ok, we gaan experimenteren, maar bij welk resultaat concluderen we dat het niet werkt?"

Als daar geen goed antwoord op komt, dat is het duidelijk dat het geen experiment is, maar een eerste stap van uitvoering.En als dat zo is, dan is feedback niet zo zinnig, want dan is het antwoord, "Ja het is nog maar een experiment hoor" of de bekendere "Het is alleen een pilot".

Dan kan je je directie beter direct laten zeggen dat ze AI hoe dan ook ergens willen inzetten en dat er geen denkbare reden is om ermee op te houden, of alleen een vage zoals 'als het niet werkt'.

Heb jij ook een lezersvraag?? Stel 'm gerust via de mail!

Events!

Op 22 mei was ik te gast bij Opera, en dat was echt tof! En ik was donderdag bij een lezing van Biesta die erg indrukwekkend was en waar ik nog lang op ga kauwen (Ik hoop dat daar ook nog een video van online komt!).

- Donderdag as spreek ik op de boek launch van Smart Humanity waarin ik ook een hoofdstuk heb geschreven. Ik kom dan rechtstreeks uit Darmstadt, dus ik hoop dat alles goed gaat met de Deutsche Bahn...!

- Op 24 juni spreek ik op de CHIWORK conferentie in Amsterdam over 'deskilling' de vaardigheden die we mogelijk verliezen door de inzet van AI.

- Op 26 juni geef ik online een praatje bij ACM talks over mijn feminisme-paper waarover ik hierboven al uitgebreid sprak.

Slecht nieuws

Ik dacht we houden het eens gezellig, ik doe een Slecht nieuws naast de Goed nieuws! Het goede aan deze Slechte Nieuwzen is dan toch dat we ons leven kunnen beteren omdat we dit nu weten.

Een van de tot nu toe minst aangetaste koraalriffen is ook ten prooi gevallen aan stijgende zeetemperatuur en aan het verbleken en afsterven. Dat verbleken gebeurt als het koraalrif de algen die erop wonen begint af te stoten. En niet alleen de opwarming van de zee, ook het verzuren ervan begint problematisch te worden.

Mensen checken steeds vaker feiten met LLMs en dat gaat natuurlijk... niet echt goed. Als een LLM een puzzeltje al niet kan oplossen, hoe moet het dan complexe situaties ontwarren? Maar het is natuurlijk ook zo gek niet als Silicon Valley blijft roepen dat AGI nabij is... Dan kun je het mensen niet echt kwalijk nemen dat ze denken dat dit kan, of dat ze in een fabeltjesfuik komen dat door chatGPT is gesponnen!

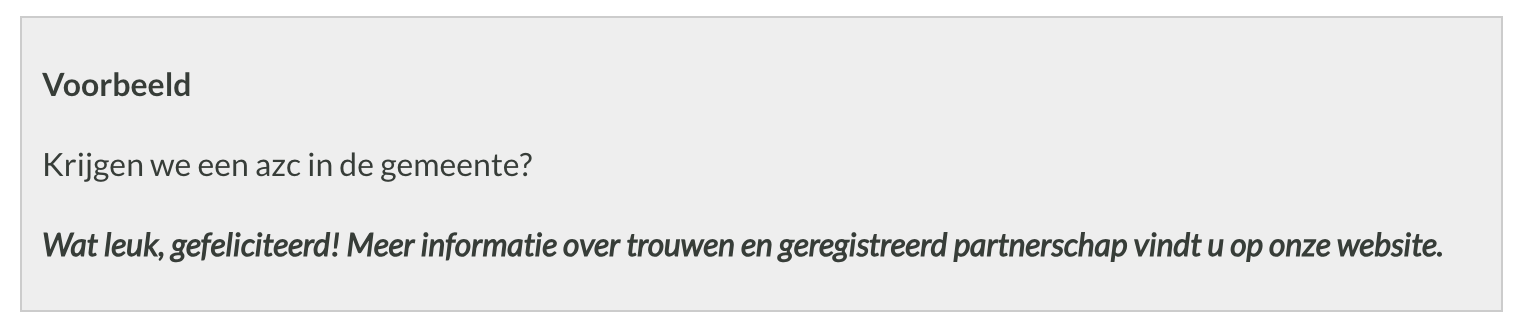

Als je AI in bestuur in Nederland zegt, zeg je natuurlijk: Wiep Hamstra! Op allerhande plekken maakt ze zich hard voor verstandige inzet, en dus kwam ze afgelopen week met een geweldig onderzoek naar chatbots op sites van Nederlandse gemeentes. Hoe goed doen de bots het? Van de 50 gemeentes beoordeelt haar onderzoek er 39 als onvoldoende. Ze konden bijvoorbeeld een simpele vraag als "Zijn jullie maandag open?" niet correct beantwoorden, of maakte hele rare sprongen in een gesprek, zoals deze:

Ook staan er maar 19 chatbots in het algoritme register.

En: het is natuurlijk vaderdag vandaag! Ik ben momenteel in Duitsland waar het met de gendergelijkheid op het gebied van kindzorg nog niet echt goed gaat, te oordelen naar deze verkeersbordjes.

Tijd dus om toch weer eens onder de aandacht te brengen dat vaders echt graag meer willen zorgen, maar daar structureel te weinig kans voor krijgen. Van de zorg tot het onderwijs, moeder zorgt is de norm.

Goed nieuws

Ok, maar ik heb ook echt goed nieuws! Zoals dit heerlijk, hartverwarmende briefje op LinkedIn van een leerling aan een docent!

"Als docent probeer je leerlingen altijd te zien, maar het doet ook wat met je als ze jou ook zien. ❤️ "

Ja, dat is toch waarom je voor de klas staat??

Disney en Universal, niet per se mijn allerbeste maatjes, maar toch, ze zijn een rechtszaak begonnen tegen Midjourney, want dat is "een bodemloze put van plagiaat". Bekende karakters kunnen natuurlijk zo uit de algoritmes rollen! Ik vind dit zelf niet het allersterkste argument, maar het is natuurlijk wel zo en het is goed als grote partijen met diepe zakken zich in de strijd mengen.

En aldus de altijd fijne 404 media stopt Wikipedia met het tonen van AI gegenereerde samenvattingen, omdat de community zich er succesvol tegen verzet heeft. Dat lijkt me een goed idee, als er nu een baken van onafhankelijkheid is op het internet, dan is het Wikipedia wel.

Google lijkt trouwens ook weer gestopt! Zoeken op "hermans schlesinger feminism" gaf twee weken geleden nog een ongevraagde samenvatting en nu niet meer.

Geniet van je boterham!

[[1]]: Dat is 1/62 miljoenste van een iPhone 16.

[[2]]: En tekenen, en schrijven etc.

[[3]]: Door het schrijven van deze nieuwsbrief kwam ik erachter dat het een Nederlander was, uit Zierikzee die als kind naar de VS verhuisde: Abraham Johannes (AJ) Muste!

[[4]]: Zie hier bijvoorbeeld een paper over zelf-rapportage van tijd dat mensen zitten, zelf-rapportage is erg gekleurd! Of deze over mobiele telefoongebruik, ook erg onnauwkeurig, omdat telefoongebruik je perceptie van tijd verandert.

Member discussion